この一ヶ月のAI関連の話題で、一番注目されたのは、AppleのAIサービスの発表では無いでしょうか。

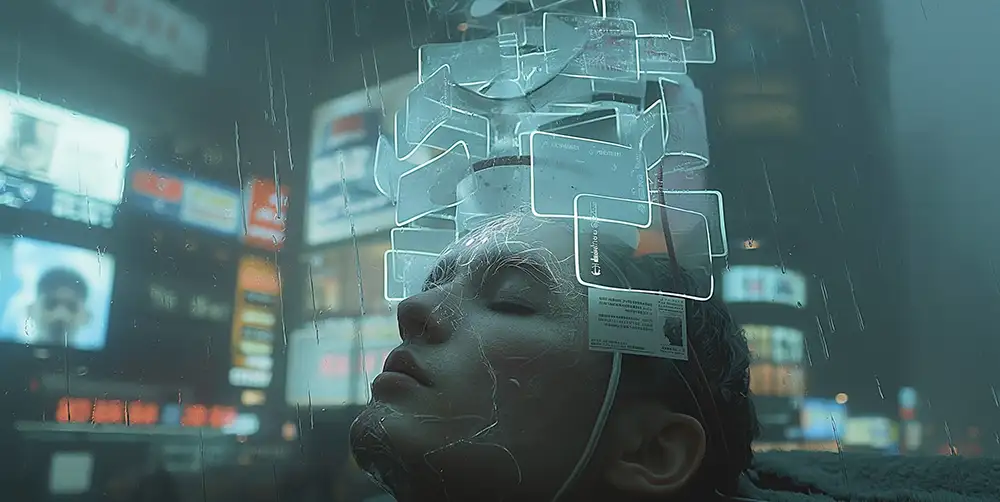

Microsoftと組んでいるOpenAIが、Appleとも組むのは意外でしたが、これでWindows、Mac OS、iOS、Chrome OS、Androidとメジャーな全てのOSにAIが組み込まれるわけで、AIがより身近なものになる展開が楽しです。

さて、今回はChatGPTと2025年に迎える日本の高齢者問題についてディベートしていたら、もしかして解決したかも?

ここから↓

[わたし]

[ChatGPT]

政府と企業はこの問題に対応するために様々な戦略を展開しています。例えば、医療・介護人材の確保、年金制度の改革、公的な負担の見直し、高齢者の就業機会の確保、技術革新による労働効率の向上などが挙げられます。

さらに、外国人労働者の受け入れを拡大し、彼らの日本社会へのスムーズな移行をサポートする施策も進められています。

また、IT分野では、旧来のシステムのサポート終了(例えばWindows 10のサポートが2025年に終了予定)に伴い、企業はデジタルトランスフォーメーション(DX)を推進し、新しい技術への移行を余儀なくされています。

このように、2025年問題は単一の問題ではなく、経済、社会、技術の各面で日本の未来に大きな影響を及ぼす複合的な課題です。政府と企業はこれらの課題に対応するための戦略を練り、実行に移している状況です。

[わたし]

そうなると、一気に年金の支出や、社会医療費の支出も減り、国には相続税も大量に入ってきます。最近生前贈与のルールも変更したので、大幅に税収アップするでしょう。

この10年、国がお金を使って、なんとか凌げば、最終的に大幅に支出も減り、税金も入ります。

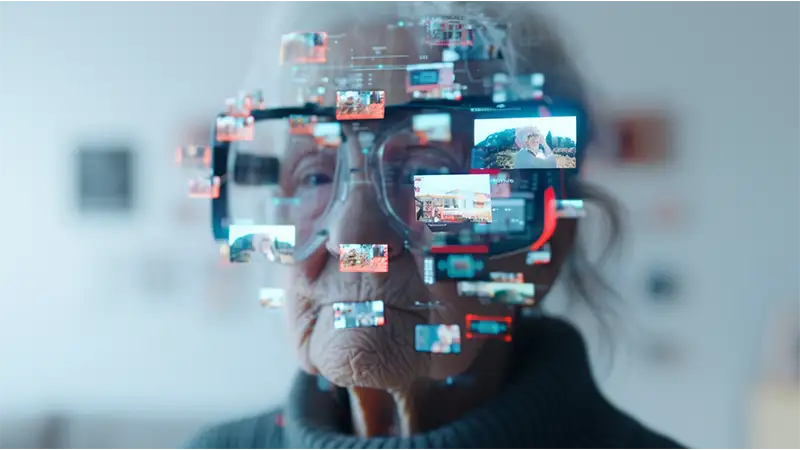

その時にはAIやロボットなどの科学技術も格段と進化して、まず問題ない社会が築けると思っています。

[ChatGPT]

現在の社会インフラの負担: 確かに団塊の世代が亡くなることによって、一時的に年金の支出や医療費の負担が軽減されるかもしれません。しかし、その前に、高齢者の増加がピークを迎える2025年前後は、社会保障システムに対して極めて大きな負担がかかります。この短期間に必要な資金をどう確保するかが問題とされています。

2.社会保障システムの持続可能性: 団塊の世代が亡くなった後、一時的に社会保障費の支出が減少するかもしれませんが、その後も少子高齢化は続いていきます。日本の人口統計を見ると、生まれてくる子供の数は減少傾向にあり、それによって将来的な労働力人口が確保できるかが不透明です。

3.技術革新の不確実性: AIやロボット技術の進展に期待することは理にかなっていますが、それが社会全体の問題を解決するかどうかはまだ確定的ではありません。技術革新が介護や医療など、人的要素が強く求められる分野でどれだけ効果的に機能するかは、実際の導入と社会の受け入れ次第です。

4.経済への影響: 高齢者が増えることで、消費行動が変わり、経済全体に様々な影響を与えます。高齢者の増加は消費の停滞を招く可能性があり、これが経済成長の鈍化をもたらす可能性があります。

これらの理由から、高齢者問題は単に「10年ほどの辛抱」で解決するよりも、もっと継続的かつ複雑な対応を必要とする大きな課題として捉えられています。政策立案者や社会全体が単に現状を凌ぐだけでなく、長期的な視点で持続可能な解決策を模索することが求められているのです。

[わたし]

[ChatGPT]

1.国際信用と金融安定性への影響: 国が保有する金は、通常、国の財政安定と通貨の信用を支えるための保険として機能します。突然大量の金を市場に放出すると、国際市場での金価格に影響を及ぼし、また日本の財政政策に対する信用を損なう可能性があります。

2.戦略的資産としての役割: 金は単に価値のある金属としてだけでなく、戦略的資産としても重要です。経済危機や通貨危機の際に、政府が金を売却して現金を調達する最後の手段として利用することができます。

3.国債発行の代替手段としての問題: 国債を発行することは、日本のようにすでに高い公的債務を抱える国にとって、さらなる債務増加を意味します。しかし、金売却に頼ることなく財政を賄う方法として、国債発行は金利や返済計画を通じてより管理しやすい方法と見なされることが多いです。

金を売却するという案は短期的な資金調達にはなるかもしれませんが、長期的な経済安定や信用の観点からはリスクが伴います。そのため、この種の資産を活用する際には、その影響を慎重に評価する必要があります。日本政府はこれらの要素を考慮に入れつつ、緊急時以外での金売却には慎重な姿勢を示しているのが現状です。

[わたし]

金を市場に放出して、金価格の急激な下落が起きて、なぜ日本の信用に影響がありますか?

「金を売却するという案は短期的な資金調達にはなるかもしれませんが、長期的な経済安定や信用の観点からはリスクが伴います。」と言われていますが、だから一時的に凌げばいいと言ってるんです。10年です。 長期的な計画と言いますが、具体的に長期とは何年ですか?

「金は単に価値のある金属としてだけでなく、戦略的資産としても重要です。経済危機や通貨危機の際に、政府が金を売却して現金を調達する最後の手段として利用することができます。」と言われますが、問題がある時に金を使って何が問題ですか?

[ChatGPT]

金を売却することに関しては、確かに大きな一時的な収入源となり得ますが、それによって市場に大量の金が流入することは、金価格に影響を及ぼし、それが国の金融政策や信用度に影響を与える可能性があります。

株式市場で株価が高い時に株を売ることが一般的には合理的ですが、国が保有する金の大量売却は市場に不安を与え、国の経済政策への信頼を損なう可能性があります。

「長期的」という言葉を具体的に定義すると、一般的には10年から30年のスパンを指します。

具体的な年数は、問題の性質や解決に必要な期間に基づいて変わりますが、政策立案では通常この範囲で計画されます。

最後に、資産運用の問題に関して、金を含む国家の資産は緊急時のリザーブとしての役割も果たします。問題が発生した際にこれらの資産を活用することは有効ですが、それは持続可能な解決策としてのみ意味を持ちます。資産の使い方については、その影響を考慮に入れつつ慎重に決定する必要があります。無責任に資産を消費することは、将来的な更なる問題を引き起こす可能性があるためです。

[わたし]

[ChatGPT]

国が保有する金や他の財政資産は、国民の経済的安全を保障し、将来の不確実性に備えるためのものです。

したがって、資産の売却については、国民全体の利益になるような状況でのみ慎重に行うべきです。短期的な財政問題を解決するためだけではなく、長期的な視野に立ってその影響を十分に評価し、国民のために最善の選択をする必要があります。

[わたし]

今から数十年後には、AIなどの科学も指数関数的に進歩します。

[ChatGPT]

また、科学技術の進歩が今後さらに加速するという見方も一つの予測として有効です。AIやロボティクスなどの技術が発展すれば、社会構造や経済システムも大きく変わる可能性があります。これにより、現在の資産が未来では異なる価値を持つかもしれません。

しかしながら、国が保有する金を売却する際には、その他のリスクも考慮する必要があります。例えば、金の大量売却が市場に与える影響、国際的な金融市場での信用問題、長期的な資産運用戦略との兼ね合いなどです。さらに、得られた資金の使い道や管理も、透明性を持って国民に説明することが求められます。

最適なタイミングについては、金価格だけでなく、社会経済的な状況、政策的な優先順位、そして国際的な環境など、複数の要素をバランス良く考慮する必要があります。国家としての戦略的な決定においては、一時的な市場の動向だけでなく、持続可能な未来への投資としての視点が重要です。

[わたし]

[ChatGPT]

金の保有は国の金融安定性と信用を示す一つの方法として国際的に認識されています。大量に金を市場に放出すると、それが国の財政的な必要性から来ていると市場に解釈されることがあり、その国の経済状態に対する懸念を引き起こす可能性があります。

国際金融市場では、安定して資産を保有していることが、その国の経済や通貨の安定性に対する信頼を示す一因となります。一方で、必要に迫られて貴重な資産を売却するという行動は、短期的には資金を提供するかもしれませんが、長期的な信用に疑問を投じる原因ともなり得ます。

さらに、国債を発行することによる借金の増加に関しても、これは確かに未来の世代に対する負担を増やす可能性があります。しかし、国債の発行は通常、市場や投資家からの資金調達として行われるため、直接的に経済を刺激し、また政府が将来にわたって支払能力を持つと市場が信じている限り、それほど信用の低下を招くものではないとされています。

資本主義の考え方においては、価値あるものを価値あるうちに売却するのは理にかなっています。しかし、国家レベルでの財政運用は、単純な投資判断以上の要素を考慮に入れる必要があるため、慎重な評価が求められます。未来への不安を最小限に抑えつつ、現在の資金調達を行う最適なバランスを見つけることが政策立案の大きな課題です。

[わたし]

[ChatGPT]

実際に、政府がそのような売却の背景と目的を明確に説明することで、信用問題を避けつつ、国際市場や他国からの信頼を保つことが可能です。

特に、日本のような先進国が前例のない社会問題に直面している場合、非伝統的な財政手段を取ることが理解される可能性はあります。金を売却するという決定が、高齢化問題への具体的な対応策として、そして将来の世代への責任を考慮した結果であることを強調することは、国際的にも肯定的に受け入れられるかもしれません。

さらに、科学技術の進展が今後の経済や社会構造に大きな変化をもたらすという観点から、現在の価値が将来ほどではない可能性がある資産を適切なタイミングで流動化することは、戦略的な財政管理の一環として理にかなっています。

結局のところ、このような政策の実施には、広範な支持と理解、そして何よりも透明性が不可欠です。国民と国際社会に対して明確かつ説得力のある説明が伴うならば、確かに金の売却は成功する可能性があります。

Just be hopeful